Des firewalls virtuels dopés aux DPU chez Palo Alto Networks

L'équipementier Palo Alto Networks commercialise une famille de pare-feu virtuels de nouvelle génération conçus spécifiquement pour être utilisés avec les DPU BlueField de Nvidia.

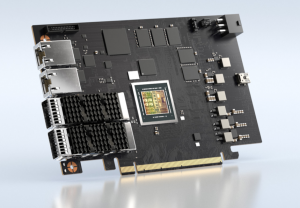

Annoncé fin 2019, le DPU BlueField-2 de Nvidia - issu du rachat de Mellanox - est conçu pour épauler les processeurs des serveurs en assurant le traitement des charges de travail réseau et sécurité. Palo Alto Networks indique que cela permet à ses pare-feu VM-Series, qui fonctionnent sur des serveurs standards, d'atteindre des débits "proches de 100 Gb/s" dans la plupart des cas d'utilisation, soit une amélioration d'un facteur 5 par rapport à l'exécution du même pare-feu sur un CPU seul. Rappelons que les Bluefield-2 reposent sur une architecture ARM Cortex-A72 (huit unités) et disposent des circuits d'accélération optimisés pour des tâches de sécuritéCette offre répond directement aux défis auxquels sont confrontés les entreprises et les opérateurs de réseau lorsqu'ils mettent en place des centres de données de type cloud, a déclaré dans un communiqué de presse Muninder Singh Sambi, SVP en charge des produits chez Palo Alto Networks.

L'utilisation des DPU et des SmartNIC pour accélérer les pare-feu n'a toutefois rien de nouveau chez des acteurs comme Intel, Nvidia ou Pliops. Les DPU et les SmartNIC sont utilisés dans les appareils de sécurité depuis des années, ce qui change, c'est que les DPU servent également sur des environnements virtuels plutôt que sur une simple appliance. Avec son projet Monterey, VMware est déjà bien engagé dans ce domaine en supportant les DPU d'Intel et Nvidia. En utilisant les Bluefiled-2, la série VM de Palo Alto Networks peut utiliser des serveurs de centres de données équipés de DPU pour s'adapter à des modèles de trafic variables.

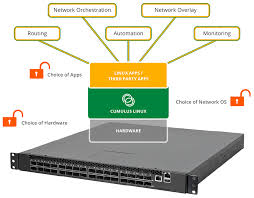

Avec ses firewalls de la série VM, Palo Alto Networks propose une technologie extensible et pilotée par API avec les principaux fournisseurs SmartNIC et DPU. (Crédit Palo Alto Networks)

Mieux analyser les flux

La plate-forme fonctionne en déchargeant les processus de filtrage et de transfert des paquets vers l'unité de traitement des données, à partir de laquelle elle analyse, classe et oriente les flux de trafic en fonction de divers critères de politique. Cela libère les ressources du processeur pour les fonctions de sécurité, tout en permettant aux utilisateurs d'éliminer le trafic qui ne bénéficiera pas de l'inspection, à l'aide d'une fonction que Palo Alto Networks appelle le déchargement intelligent du trafic (ITO).

« Jusqu'à 80 % du trafic réseau, y compris les médias et les données cryptées dans un centre de données, n'ont pas besoin d'être - ou ne peuvent pas être - inspectés par un pare-feu », a écrit Ash Bhalgat, directeur principal du cloud chez Nvidia, dans un billet de blog. Si, par exemple, le pare-feu détecte du trafic média chiffré ou en streaming, la plate-forme demande au DPU de transférer tous les paquets suivants vers leur destination, libérant ainsi des cycles de CPU pour un trafic plus prioritaire « Dans de tels environnements, le délestage intelligent du trafic garantira que les ressources du pare-feu sont utilisées de manière optimale pour inspecter uniquement les flux qui bénéficient d'une inspection de sécurité continue », a complété M. Bhalgat .